從0開始學大數據06 新技術層出不窮,HDFS依然是存儲的王者

引言

在大數據技術日新月異的今天,各種新型的存儲和處理框架層出不窮,例如云原生存儲、對象存儲、實時數據庫等。當我們深入大數據生態系統的核心時,會發現Hadoop分布式文件系統(HDFS)依然穩坐“存儲王者”的寶座。為什么在新技術浪潮中,HDFS能保持其不可撼動的地位?本文將帶你從數據處理和存儲服務的角度,一探究竟。

HDFS的核心優勢

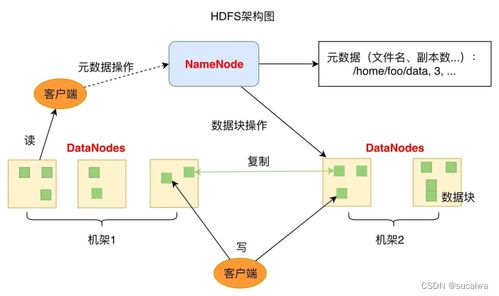

- 高容錯性與可靠性:HDFS通過數據塊的多副本機制(默認3副本),確保即使某個節點發生故障,數據也不會丟失。這種設計特別適合大規模集群環境,保障了數據存儲的持久性。

- 高吞吐量訪問:HDFS針對一次寫入、多次讀取的場景優化,能夠高效處理海量數據的批處理任務。例如,在MapReduce、Spark等計算框架中,HDFS能提供穩定的數據支持。

- 成本效益:HDFS可以部署在廉價的商用硬件上,通過橫向擴展來增加存儲容量,避免了傳統存儲系統的高昂成本。

- 成熟的生態系統:作為Hadoop生態的基石,HDFS與眾多大數據工具(如Hive、HBase、Flink)無縫集成,形成了完整的數據處理鏈條。

新技術浪潮下的挑戰與機遇

盡管云存儲(如AWS S3、Azure Blob Storage)和實時數據庫(如Kafka、Cassandra)在大數據領域嶄露頭角,但它們往往與HDFS形成互補而非替代關系:

- 云存儲:適合冷數據備份或跨區域共享,但實時計算性能可能不及HDFS。

- 實時數據庫:擅長流處理,但缺乏HDFS的海量存儲能力。

HDFS通過持續演進(如支持糾刪碼以降低存儲開銷、優化小文件處理)來應對新需求,同時其“數據本地化”特性(將計算任務調度到數據所在節點)仍是提升效率的關鍵。

數據處理與存儲服務的實踐場景

在實際應用中,HDFS常作為數據湖的核心存儲層:

1. 數據采集與存儲:將日志、交易數據等原始信息批量寫入HDFS,形成可追溯的數據基礎。

2. 批量處理:通過MapReduce或Spark對HDFS中的數據進行ETL(提取、轉換、加載),生成結構化數據集。

3. 混合架構:結合Kafka處理實時流數據,并將結果持久化到HDFS,實現批流一體的數據處理。

例如,某電商平臺使用HDFS存儲歷史訂單數據,通過Spark進行用戶行為分析,同時用S3備份非活躍數據,形成高效且經濟的存儲體系。

未來展望

隨著AI和物聯網的興起,數據量呈現爆炸式增長。HDFS的演進方向可能包括:

- 更好地融合云原生技術,支持彈性伸縮。

- 增強對非結構化數據(如圖像、視頻)的管理能力。

- 優化與內存計算、GPU加速等新硬件的協作。

但無論如何,其核心設計理念——可靠、可擴展、低成本——將繼續為大數據存儲奠定基石。

###

大數據的世界雖不斷有新星閃耀,但HDFS憑借其經久考驗的架構和生態優勢,依然是存儲領域的“定海神針”。對于學習者而言,深入理解HDFS的原理與應用,不僅是掌握大數據技術的必經之路,更是應對未來技術變革的堅實基礎。在下一講中,我們將探索如何基于HDFS構建數據處理管道,敬請期待!

如若轉載,請注明出處:http://www.pcltpj.cn/product/79.html

更新時間:2026-04-14 07:33:53